헬창 개발자

[졸업 프로젝트] 감정 - 7 (END) - 본문

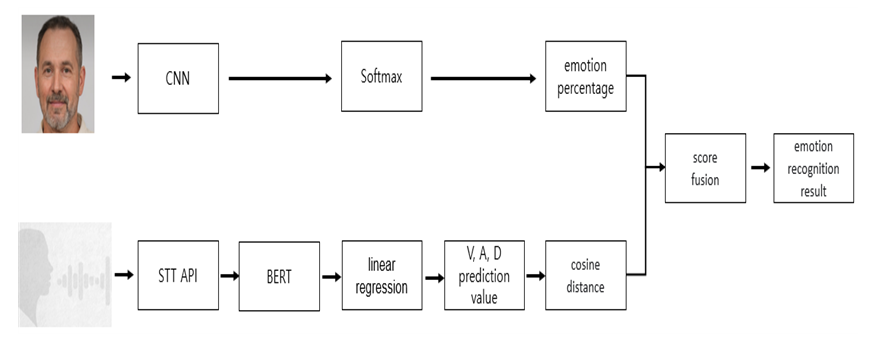

이번 포스팅에서는 얼굴 감정 인식 모델과 텍스트 감정 인식 모델의 감정을 어떻게 하나로 합치는지를 설명합니다.

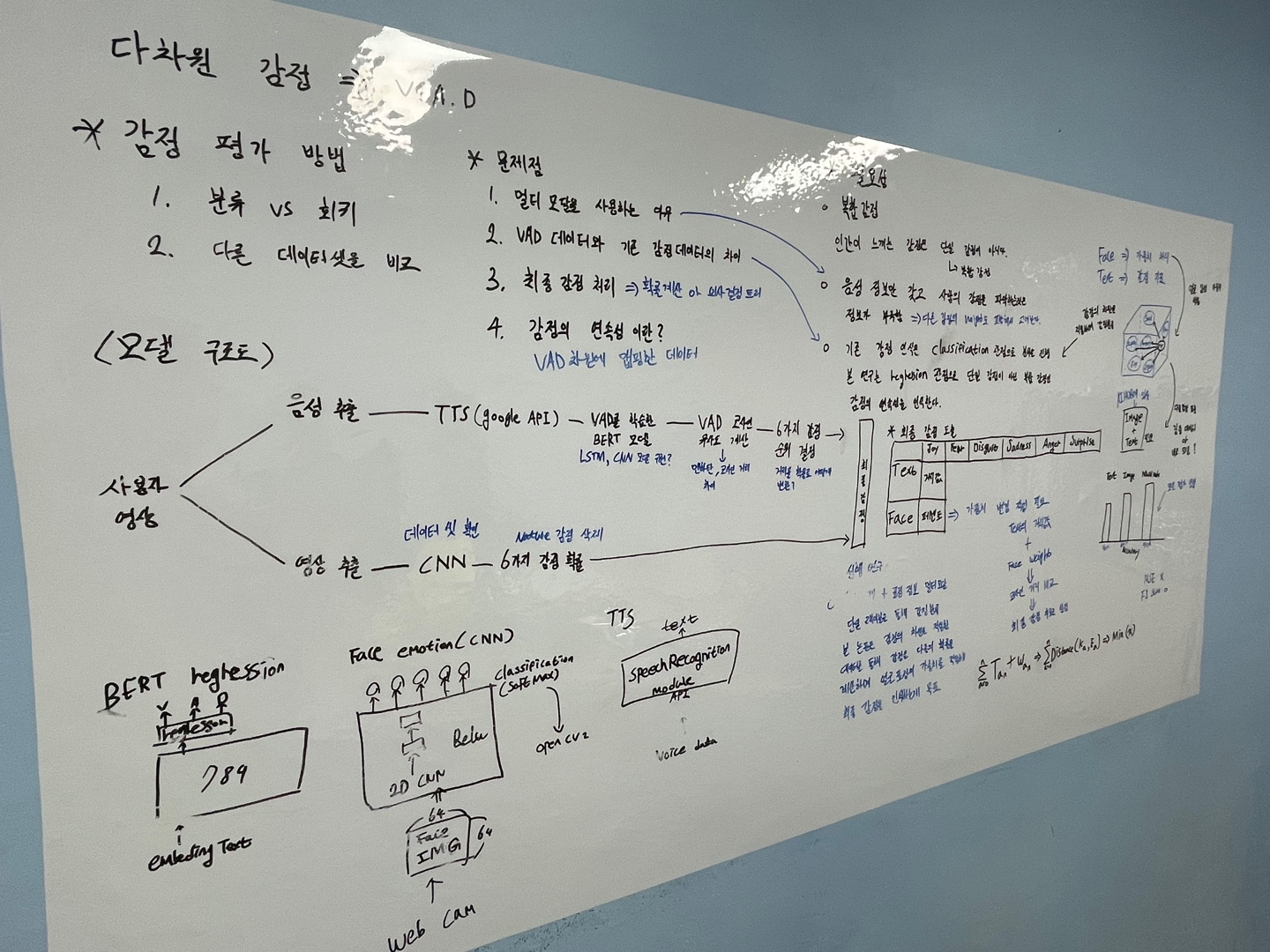

제가 제안한 모델 구조입니다. 얼굴 감정의 결과는 각 감정의 확률로 나오고 텍스트 감정의 결과는 코사인 거리를 계산하여 도출 합니다. 두 개의 모델을 합치기 위해선 새로운 수식이 필요한데 저는 밑의 수식처럼 멀티모달의 감정 수식을 계산 했습니다.

Em은 두 개의 감정을 결합하여 생선한 최종 감정을 의미하며 Et와 Es는 가각 얼굴과 텍스트에 대한 감정 순위를 의미합니다. p는 얼굴 감정에 부여하는 가중치이며, 텍스트 감정에 대한 가중치는 (1-p)로 모든 가중치의 합은 1이 됩니다.

이제 실험 평가를 해봐야겠죠??

저는 AIHUB에서 제공하는 멀티 모달 데이터셋을 이용하여 평가했습니다.

https://aihub.or.kr/aihubdata/data/view.do?currMenu=115&topMenu=100&aihubDataSe=realm&dataSetSn=58

AI-Hub

※ 내국인만 데이터 신청이 가능합니다. 목록 데이터 개요 데이터 변경이력 데이터 변경이력 버전 일자 변경내용 비고 1.0 2019-12-31 데이터 최초 개방 소개 AI 8종 임무 유형을 고려한 감정, 성별,

aihub.or.kr

실험결과

얼굴 가중치가 0.7 일때 정확도가 제일 높을것을 확인할 수 있습니다. 이는 얼굴 감정을 사용했을 때 65% 텍스트 감정을 사용했을 때 60% 보다 향상된 인식률을 보여줍니다.

---------------------------------------------------------------------------------------------------------------------------------------------------------

후기

https://www.dbpia.co.kr/journal/articleDetail?nodeId=NODE11413176

얼굴 영상과 다차원 감정 기반의 텍스트를 이용한 멀티모달 감정인식 시스템 | DBpia

조찬영, 정현준 | 한국정보기술학회논문지 | 2023.05

www.dbpia.co.kr

해당 연구는 23.05 기준으로 한국정보기술학회논문지에 출판되었습니다 :)

'프로젝트' 카테고리의 다른 글

| 2023 전북 공공데이터 창업경진대회 출품작 _ 하루이즘 (2) | 2023.07.25 |

|---|---|

| [토이 프로젝트] MZ 테스트 (0) | 2023.03.27 |

| [졸업 프로젝트] 감정 -6- (1) | 2023.02.14 |

| [졸업 프로젝트] 감정 -5- (1) | 2023.02.03 |

| [졸업 프로젝트] 감정 -4- (0) | 2023.02.03 |